Wan 2.7:先頭フレーム制御と15秒クリップ生成に対応したAlibabaの新しい動画モデル

Wan 2.7は、Alibabaのオープンソース動画モデルラインナップに、先頭/最終フレーム制御、multi-reference 動画入力、指示ベースの編集機能を追加しました。Wan 2.6からの変更点を解説します。

ざっくりまとめ — 知っておくべき5つのポイント

- ✅ 最初/最後フレーム制御 (FLF2V) — 開始フレームと終了フレームを設定すると、Wan 2.7がその間のモーションを補完します

- ✅ 最大5つの参照動画出力 — 複数の参照クリップを入力して、キャラクター、環境、モーションスタイルをガイドできます

- ✅ 最大15秒のクリップに対応 — 旧バージョンのWanモデルの3倍の長さです

- ✅ 指示ベースの動画編集 — 自然言語で背景、照明、スタイルを変更できます

- ❌ ネイティブでの4K出力に対応せず — 最大解像度は1080Pです。ローンチ時点ではオープンソースリリースの状況は確定していません

Wan 2.7とは?

Wan 2.7 は、アリババのTongyi Labによる最新の動画生成モデルです。2026年3月にWaveSpeedAI API(wavespeed.ai)およびアリババクラウドのDashScopeプラットフォームを通じて利用可能になりました。公式のGitHubリリースは現在準備中です。

Wanはアリババの旗艦オープンソース動画生成ファミリーです。Wan 2.1はApache 2.0ライセンスでリリースされ、多くの開発者に採用されてきました。Wan 2.7はこれまでで最も高性能なバージョンで、旧リリースにはなかったプロフェッショナル向けの制御機能が多数追加されています。

本モデルは Diffusion Transformer + Flow Matching アーキテクチャを基盤としており、推定約270億のパラメータを持っています。これは現在の高性能動画モデルと同じアーキテクチャ分類に入り、古いDDPMスタイルの拡散モデルではなく潜在フローマッチングを使用することで、より高速で安定した生成を実現しています。

Wan 2.6からの変更点

Wan 2.7はマイナーパッチではありません。実質的な機能の差分は以下の通りです。

| 機能 | Wan 2.6 | Wan 2.7 |

|---|---|---|

| テキストから動画 | ✅ | ✅ |

| 画像から動画 | ✅ | ✅ |

| 最初/最後フレーム制御 (FLF2V) | ❌ | ✅ |

| 複数参照動画出力 | ❌ | ✅ (最大5つ) |

| 9グリッド画像入力 | ❌ | ✅ |

| 指示ベース動画編集 | ❌ | ✅ |

| 多言語リップシンク | ❌ | ✅ |

| 最大クリップ長 | 約5秒 | 15秒 |

| 最大解像度 | 1080P | 1080P |

追加された機能は非常に大きなものです。最初/最後フレーム制御、multi-reference入力、指示編集はいずれもプロフェッショナルなワークフローに必要な機能で、Wan 2.6には欠けていたものです。

主な新機能の詳細

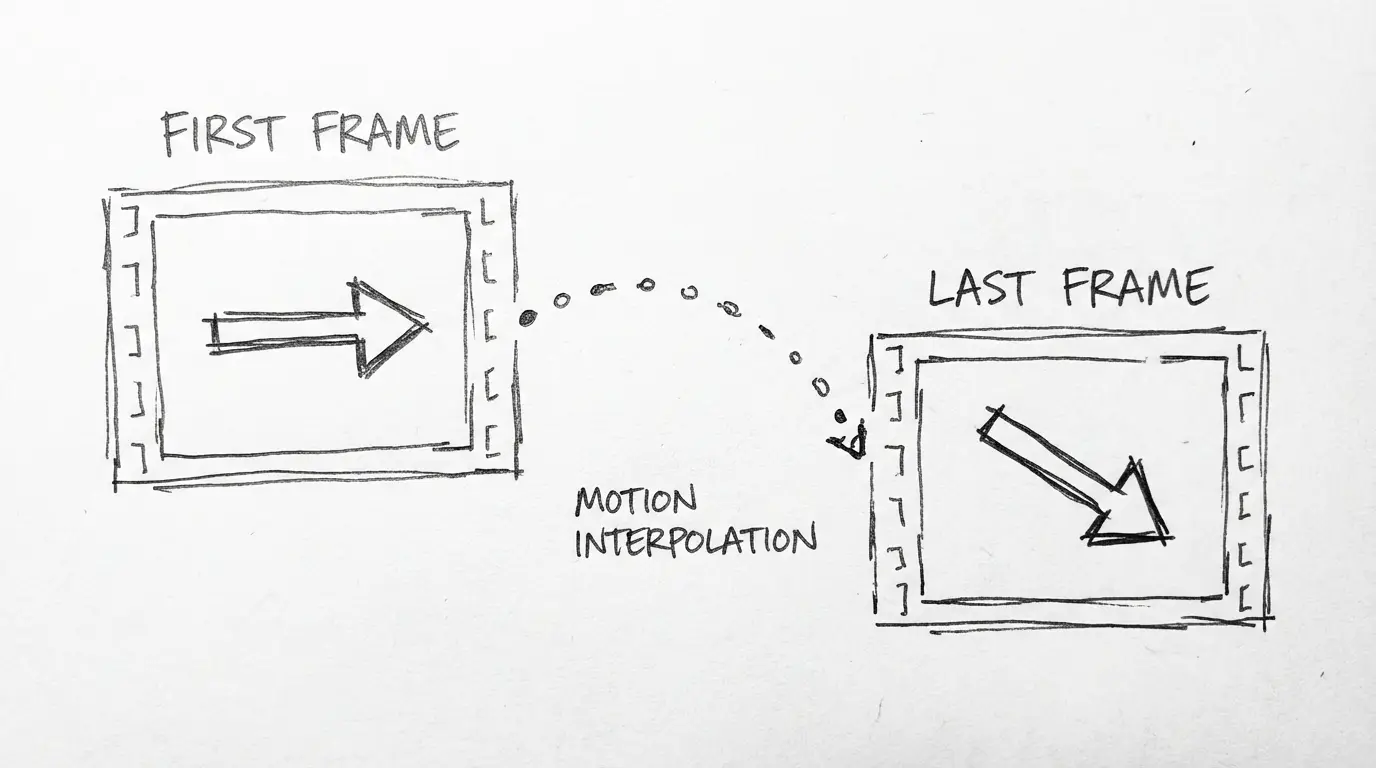

最初/最後フレーム制御 (FLF2V)

FLF2Vでは、動画の最初と最後のフレームを両方定義すると、Wan 2.7がその間のモーションを生成します。これは商用制作において非常に有用な制御機能です。具体的な開始の構図を設定し、ショットの終了位置を指定したら、モデルが中間のカメラと被写体の動きを処理してくれます。

活用例:

- アイテムが中央から開始し、特定の角度で終了する必要があるプロダクトショット

- 両端でポーズの変化を正確にする必要があるキャラクターアニメーション

- 定義済みの2つの構図間の映画的なトランジション

複数参照動画出力

Wan 2.7は同時に最大5つの参照動画を入力できます。モデルはこれらを読み込み、生成されるクリップ内のキャラクターの一貫性、環境のスタイル、モーションパターンに反映させます。これは単一画像の参照よりも高度で、動画生成で長らく指摘されていた「ショットをまたいでキャラクターの外見が一定に保たれない」という問題に対応しています。

商用利用では、これによりプロダクトの動き方、人物の外見、希望する環境のスタイルの例を提供するだけで、モデルがそのコンテキストを新しい生成に反映してくれます。

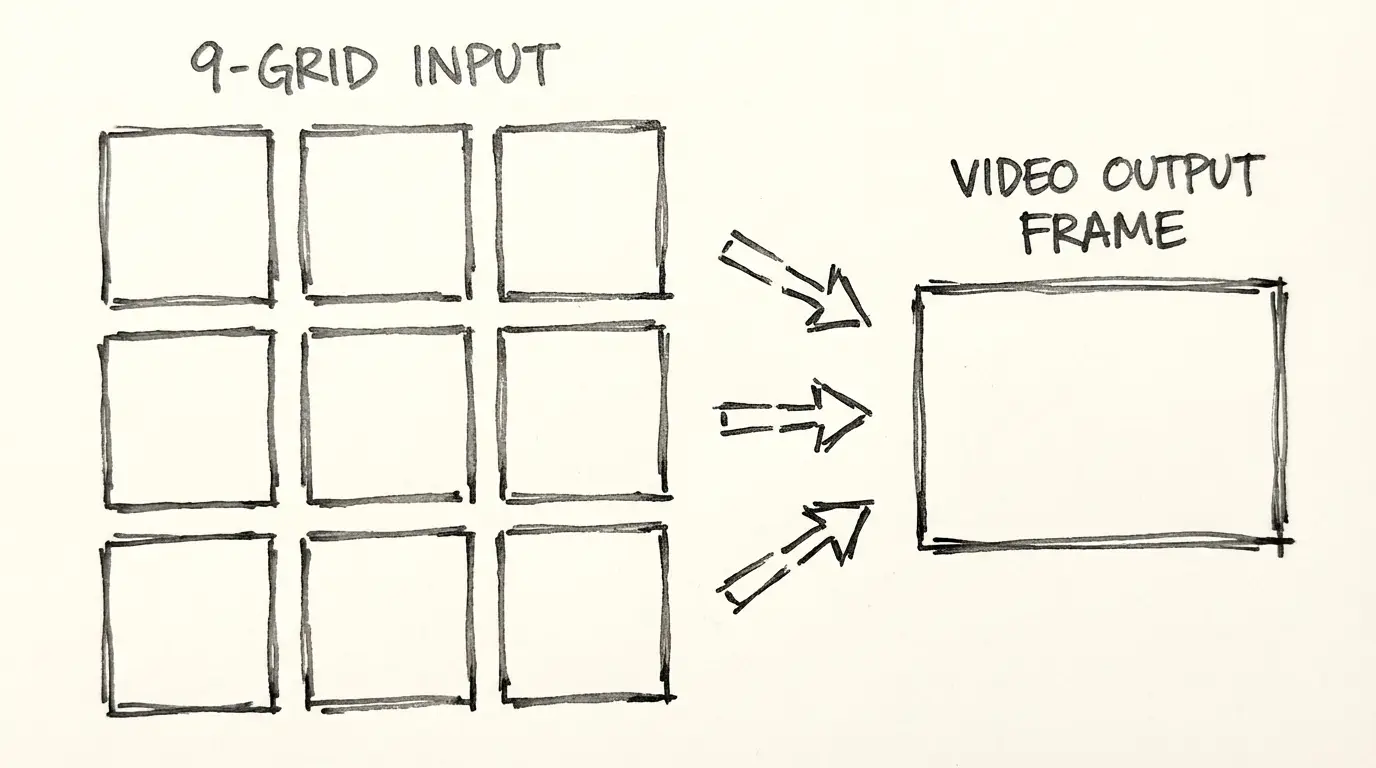

9グリッド画像入力

9グリッド入力では、3×3に配置した画像を1つの入力として受け付けます。モデルは9枚すべてのフレームを読み込み、複数の角度からコンテキスト、キャラクター、環境を理解します。これは特に、単一の参照画像では十分なディテールが得られないキャラクターの一貫性が必要な作業で有用です。

指示ベースの動画編集

ゼロから再生成するのではなく、Wan 2.7は既存の動画を自然言語の指示で変更することができます。変更したい内容(背景色、照明の雰囲気、被写体の服、視覚スタイルなど)を記述するだけで、モデルは元のモーションを保持したまま編集を適用します。

承認済みのモーションに対して小さな調整が頻繁に発生する商用動画制作において、イテレーションコストを大幅に削減できます。

多言語リップシンク

Wan 2.7に多言語リップシンクサポートが追加されました。これは生成されたキャラクターの発話アニメーションを、複数の言語の音声に同期させられるということで、ローカライズワークフローにとって非常に有用な機能です。

技術仕様

| 仕様 | Wan 2.7 |

|---|---|

| アーキテクチャ | Diffusion Transformer + Flow Matching |

| パラメータ数 | 約27B (推定) |

| 解像度 | 480P, 720P, 1080P |

| 動画長 | 2~15秒 |

| アスペクト比 | 16:9, 9:16, 1:1 |

| モード | T2V, I2V, FLF2V, 指示編集 |

| APIアクセス | WaveSpeedAI, アリババクラウドDashScope |

| オープンソース | Apache 2.0で計画中 (ローンチ時点ではステータス未定) |

| 処理時間 | 5秒の1080Pクリップで約30秒~2分 |

既知の制限

どのモデルも完璧ではありません。Wan 2.7が対応していない点は以下の通りです:

- ネイティブでの4K出力に対応していません。 最大解像度は1080Pです。デジタルサイネージ、シネマプレビズ、大画面表示のために4Kが必要な場合は、別のモデルを使用するか、ポスト処理でアップスケールする必要があります。

- オープンソースリリースはローンチ時点で未確定です。 Wan 2.1はApache 2.0で完全にオープンソースでしたが、本記事執筆時点でWan 2.7のオープンソースリリースの状況は公式発表されていません。最新情報はAlibaba WanのGitHubをご確認ください。

- 公式価格は公開されていません。 WaveSpeedAIとDashScopeのAPI価格は、各プラットフォームで直接ご確認ください。参考としてはWan 2.6のAPI料金がありますが、Wan 2.7の価格は異なる可能性があります。

- 新しいモデルのため、コミュニティテストが限られています。 Wan 2.7はリリースされたばかりです。旧モデルのような広範なコミュニティテストはこれから蓄積されていく段階です。

Wan 2.7の使い方

オプション1: NanoBanana を使用する(APIセットアップ不要)

NanoBanana にあるWan 2.7 動画生成ツールにアクセスし、prompt を記入して動画の長さとアスペクト比を選択し、生成するだけです。APIキーやDashScopeのアカウントは必要ありません。

オプション2: WaveSpeedAI API

wavespeed.ai でアカウントを作成してください。Wan 2.7 はAPIエンドポイントとして利用可能です。prompt、モード(T2V または I2V)、動画の長さ(2~15秒)、解像度(480P、720P、1080P)、アスペクト比を指定してPOSTリクエストを送信してください。

オプション3: Alibaba Cloud DashScope

既にAlibaba Cloudのサービスを利用している場合、Wan 2.7 はDashScope APIからアクセス可能です。DashScopeコンソールでAPIキーを生成し、リクエスト内でWan 2.7のモデルIDを参照して使用してください。

よくある質問(FAQ)

Wan 2.7 を今すぐ試す

→ Wan 2.7 で生成する — text-to-video と image-to-video が利用でき、APIセットアップは不要です。

情報開示

モデルの仕様と機能の説明は、Wan 2.7に関するAlibaba Tongyi Labの公式リリース資料(2026年3月)とWaveSpeedAI APIドキュメントを出典としています。本記事の公開時点では、オープンソースリリースの状況と公式価格は確認待ちです。いずれも公式のAlibaba Wan GitHub と wavespeed.ai でそれぞれ最新情報をご確認ください。

続きを読む

Seedance 2.0: ByteDanceのマルチモーダルAI動画生成 完全ガイド

マルチモーダル入力、ネイティブな音声・動画同期、2K解像度出力、ディレクター級のクリエイティブコントロールを特徴とする、ByteDanceの革新的なAI動画モデル「Seedance 2.0」の全貌をご紹介します

AI Image Agent:1枚も100枚も、ツールを切り替えずに画像生成可能

NanoBananaのAI Image Agentは、単一のコンセプト画像からバッチスタイルトランスファーまで、1つのチャットですべて処理できます。promptのエンジニアリングは不要です。

Google Veo 3.1 Lite:Veo 3.1 Fastの半額で、速度は同等

Google は2026年3月31日にVeo 3.1 Liteをローンチしました。こちらはVeoファミリーで最も手頃な価格のモデルで、720pの場合1秒あたり0.05ドルで利用できます。本記事では、本モデルができること、できないこと、そしてあなたのワークフローに適しているかどうかを解説します。