PixVerse V6:电影级摄影机控制、原生音频与15秒视频片段

PixVerse于2026年3月30日推出V6版本——带来20余项电影级摄影机控制、原生音频同步、多镜头引擎,以及最长15秒的1080p原生输出。本文将介绍本次更新内容,以及它是否适配你的工作流。

要点速览 — 你需要知道的5件事

- ✅ 20+ 电影摄影机控制 — 推轨、摇臂、环绕、跟拍等,全部支持参数化调节

- ✅ 原生音频同步 — 可在生成视频的同时生成环境音、音效和对话

- ✅ 多镜头引擎 — 可在一次生成任务中定义多个场景组成的序列

- ✅ 原生1080p分辨率下最长支持15秒 — 几乎是之前8秒上限的两倍

- ✅ 5种生成模式 — T2V、I2V、转场、扩展、多镜头

什么是 PixVerse V6?

PixVerse V6 于2026年3月30日正式发布,距离V5.6(2026年1月26日发布)过去了两个月。这是PixVerse产品线的第六个主要版本,也是迄今为止意义最重大的架构升级。

本次新增的核心功能并非增量式的质量提升,而是全新的能力类别:电影摄影机控制、原生音频生成和多镜头引擎。每个功能都解决了旧版本存在的不同专业工作流程痛点。

PixVerse 将V6定位为面向创作者的生产级工具,满足创作者不止于"生成一个片段"的需求。尤其是摄影机控制系统,直接响应了创作者一直以来的诉求:你需要的不只是更好的素材,而是对素材构图的导演级掌控。

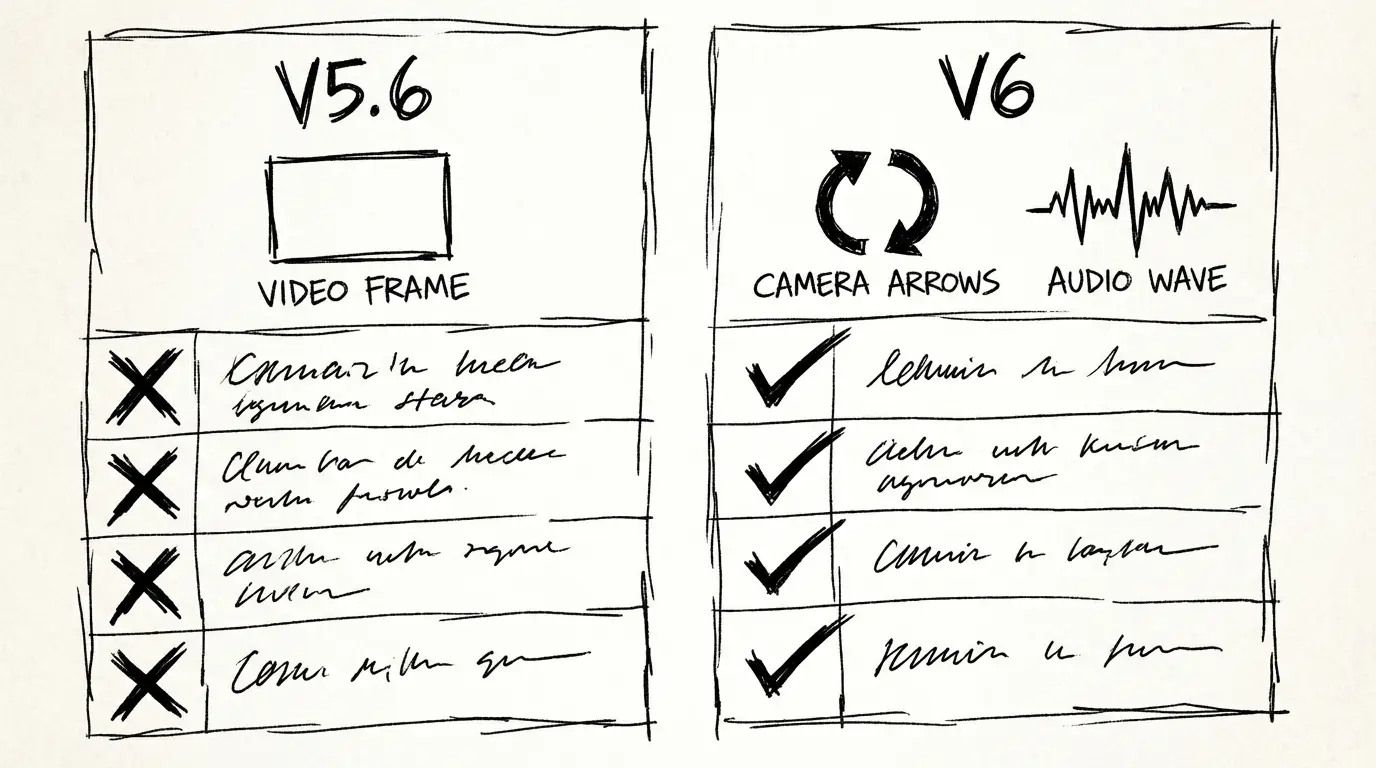

相较V5.6有哪些变化

| 功能 | V5.6 | V6 |

|---|---|---|

| 文生视频 | ✅ | ✅ |

| 图生视频 | ✅ | ✅ |

| 视频转场(图生视频锚点) | ✅ | ✅ |

| 片段扩展 | ✅ | ✅ |

| 多镜头引擎 | ❌ | ✅ |

| 电影摄影机控制 | 基础功能 | ✅ 20+ 种控制 |

| 原生音频生成 | ❌ | ✅ |

| 最大片段时长 | 8秒 | 15秒 |

| 原生分辨率 | 720p | 1080p |

| 支持画幅比例 | 16:9, 9:16, 1:1 | 16:9, 9:16, 1:1, 4:3, 3:4 |

时长从8秒提升到15秒、原生分辨率从720p提升到1080p,这两项改动本身就已经意义重大。再结合音频同步和多镜头引擎,V6让单次生成能够输出的内容质量得到了实质性的飞跃。

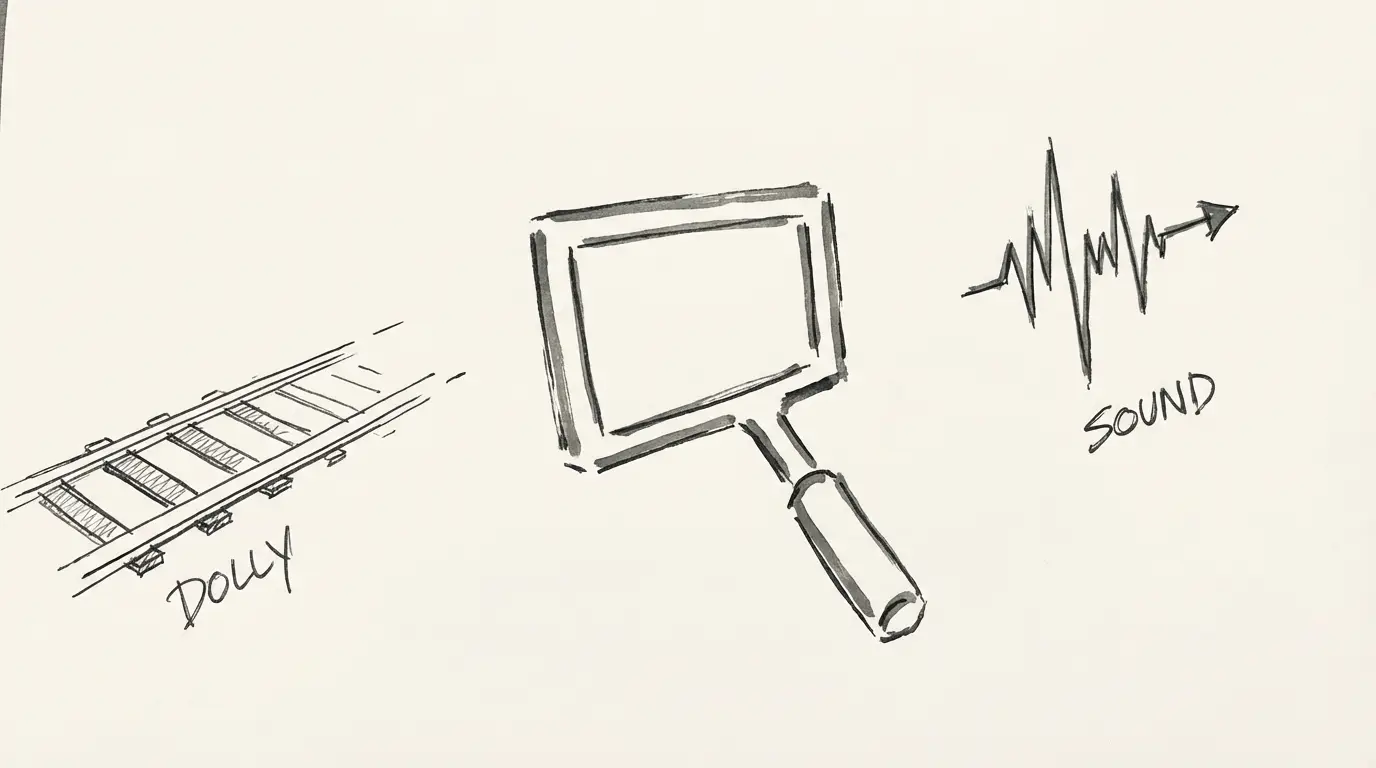

电影摄影机控制:20+ 种控制到底指什么

摄影机控制系统是V6技术层面最值得关注的部分。此前的视频生成模型要么完全不考虑摄影机运动(全由模型随机决定),要么只提供少量命名预设。而V6给了你可参数化的完整控制。

支持的摄影机运动包括:

平移运动:推轨向前、推轨向后、左横移、右横移、升机、降机

旋转运动:左摇、右摇、上摇、下摇、滚转

组合运动:环绕、摇臂拍摄、跟拍、手持拍摄、变焦推轨(眩晕效果)

控制参数:速度(慢/中/快)、缓动(线性/缓入/缓出)、起始帧

这不是一个简单的"电影感模式"开关。这些都是你可以为每个片段单独配置的参数。实际使用中,你可以指定"摇臂升起,慢速,前2秒缓入",模型就会按你的要求执行生成。

对于产品创作来说,这非常实用:主角镜头的缓慢推镜不再是你寄希望于模型随机生成的风格选择,而是你可以明确指定的效果。

原生音频:工作原理

PixVerse V6 会在生成视频的过程中同步生成音频,而非后期追加处理。你可以控制以下几类音频:

环境音:可在prompt中描述,或由模型根据场景推断。厨房场景会生成厨房环境音,沿海公路会生成风声和海浪声。

音效:会与特定视觉事件同步。产品落在桌面上,会在对应帧生成撞击声。

对话:角色可以说出你指定的台词。唇形同步精度会有所不同 — 简短、表述清晰的对话能获得更可靠的同步效果。

音频和视频会在同一次生成流程中产出。你不需要额外的音频生成步骤,也不需要后期工作流为V6输出添加声音。

对于社交内容和产品演示来说,这非常实用:大多数情况下,生成的输出可以直接发布,不需要额外处理音频。

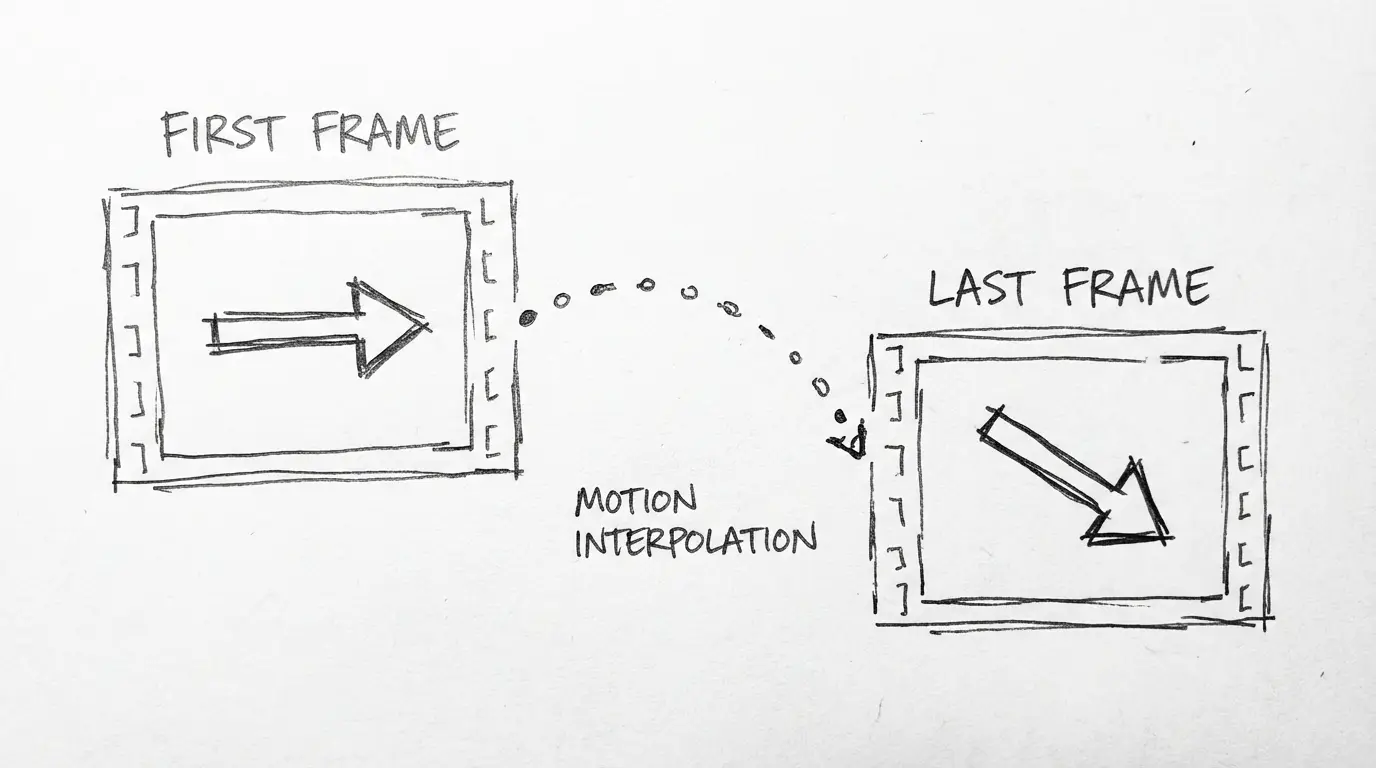

多镜头引擎

多镜头引擎是V6中对工作流改变最大的功能。此前,创建一个多场景序列需要单独生成每个片段,再在后期剪辑拼接到一起。而V6允许你在单次生成中定义镜头列表。

工作原理:你按顺序描述多个场景 — 场景A(定场)、场景B(特写)、场景C(反应镜头)。V6会将它们生成为一个连续片段,在不同镜头间保持一致的角色、光照和环境。

解决的问题:连续性。当你拼接单独生成的片段时,不同镜头中的角色外观可能不一样,光照会发生偏移,空间关系也会改变。多镜头引擎可以保持一致性,因为所有镜头都在同一次生成流程中产出。

当前限制:多镜头引擎在单次生成使用2-3个场景时效果最好。更复杂的镜头列表会降低输出的一致性。在最长15秒的时长限制下,刚好足够容纳2-3个节奏合理的镜头。

支持的生成模式

PixVerse V6 提供五种不同的生成模式:

| 模式 | 说明 | 适用场景 |

|---|---|---|

| 文生视频(T2V) | 仅通过prompt生成 | 概念探索、无特定视觉锚点的场景 |

| 图生视频(I2V) | 基于参考图像生成动态视频 | 产品展示、人物动态、要求特定视觉保真度的场景 |

| 转场 | 带有两个锚点图像(起始+结束)的图生视频 | 品牌亮相、前后对比、物体变换 |

| 延长 | 延长现有视频片段 | 拉长优质片段、为已生成视频增加时长 |

| 多镜头 | 一次生成多个连续场景 | 短叙事内容、产品演示序列 |

在本平台,你可以直接使用文生视频和图生视频生成内容。

谁适合使用 PixVerse V6

| 场景 | 推荐选择 |

|---|---|

| 需要特定运镜的产品演示 | V6 |

| 社交媒体内容(Shorts、Reels、TikTok) | V6 |

| 无需手动拼接的多场景序列 | V6 |

| 简单文生片段,无需相机控制 | 任意模型 |

| 大屏展示的最高画质 | 可与标准版模型对比使用 |

相机控制系统和多镜头引擎是 V6 相比上一代最明显的差异化优势。如果这些功能对你的工作流有帮助,V6 无疑是最佳选择。如果你只需要通过文本prompt生成一段可靠的视频,V6 依然有竞争力,但额外功能并非必需。

如何使用 PixVerse V6

选项1:使用本平台(无需配置API)

前往 PixVerse V6 生成器,输入你的prompt,选择时长和宽高比即可生成。无需API密钥,也不需要注册账号。

选项2:通过 fal.ai API 访问

你可以通过 fal.ai 使用 PixVerse V6,你需要一个 fal.ai 账号和API密钥。该模型同时支持T2V和I2V模式,定价根据分辨率以及是否启用音频生成而有所不同。

选项3:直接通过PixVerse平台使用

PixVerse 在 pixverse.ai 运营自己的网页平台,网页端可以使用全部五种生成模式,包括转场和多镜头。

体验 PixVerse V6

PixVerse V6 生成器 无需配置API即可直接使用,平台支持文生视频和image-to-video模式。

深入了解

常见问题

信息披露

功能规格和发布日期均来源于PixVerse 2026年3月30日的官方公告,以及fal.ai的PixVerse V6 API文档。本文定价信息为发布时的fal.ai价格,可能会发生变动。

更多文章

Wan 2.7:阿里巴巴推出的支持首帧控制、可生成15秒视频的全新视频模型

Wan 2.7为阿里巴巴的开源视频模型系列带来了首/末帧控制、multi-reference视频输入以及基于指令的编辑能力。以下是它相较于Wan 2.6的所有更新内容。

AI图像代理:生成一张或百张图像 — 无需切换工具

NanoBanana 的AI图像代理可在单次对话中完成从单张概念图像到批量风格迁移的所有任务,无需prompt工程技术相关操作。

AI视频导演:NanoBanana的智能代理如何将你的创意转化为完整视频

NanoBanana的AI视频导演代理可通过单一prompt自动完成完整的视频制作流程——剧本、角色、场景、故事板以及最终视频片段