Wan 2.7: 첫 프레임 제어와 15초 클립을 지원하는 알리바바의 새로운 비디오 모델

Wan 2.7은 알리바바의 오픈소스 비디오 라인업에 첫/마지막 프레임 제어, multi-reference 비디오 입력, 명령 기반 편집 기능을 추가했습니다. Wan 2.6에서 달라진 점을 소개합니다.

요약 — 알아두어야 할 5가지

- ✅ 시작/종료 프레임 제어 (FLF2V) — 오프닝과 클로징 프레임을 설정하면 Wan 2.7이 그 사이의 모션을 채워줍니다

- ✅ 최대 5개의 참조 비디오 입력 지원 — 캐릭터, 환경, 모션 스타일을 가이드하기 위해 여러 개의 참조 클립을 입력할 수 있습니다

- ✅ 최대 15초 길이 클립 지원 — 기존 Wan 모델보다 3배 더 깁니다

- ✅ 명령 기반 비디오 편집 — 자연어를 통해 배경, 조명, 스타일을 변경할 수 있습니다

- ❌ No 4K 네이티브 출력 지원 안됨 — 최대 해상도는 1080P이며, 출시 시점 오픈소스 릴리스 상태는 확정되지 않았습니다

Wan 2.7이란 무엇인가?

Wan 2.7은 알리바바 통의 연구실(Tongyi Lab)에서 개발한 최신 비디오 생성 모델입니다. 2026년 3월 WaveSpeedAI API (wavespeed.ai)와 알리바바 클라우드 DashScope 플랫폼을 통해 사용할 수 있게 되었으며, 공식 GitHub 릴리스는 아직 예정되어 있습니다.

Wan은 알리바바의 플래그십 오픈소스 비디오 생성 모델 제품군입니다. Wan 2.1은 Apache 2.0 라이선스로 출시되어 상당한 개발자 채택을 이끌어냈습니다. Wan 2.7은 지금까지 나온 버전 중 가장 성능이 뛰어난 버전으로, 이전 릴리스에 없었던 전문가 수준의 제어 기능 세트를 추가했습니다.

이 모델은 Diffusion Transformer + Flow Matching 아키텍처를 기반으로 구축되었으며, 약 270억 개의 매개변수로 추정됩니다. 이는 현재 고성능 비디오 모델 세대와 동일한 아키텍처 분류에 속하며, 기존 DDPM 스타일 확산 모델 대신 잠재 플로우 매칭을 사용해 더 빠르고 안정적인 생성을 제공합니다.

Wan 2.6에서 달라진 점

Wan 2.7은 사소한 패치가 아닙니다. 실제 기능 변경 사항은 다음과 같습니다:

| 기능 | Wan 2.6 | Wan 2.7 |

|---|---|---|

| 텍스트-비디오 변환 | ✅ | ✅ |

| 이미지-비디오 변환 | ✅ | ✅ |

| 시작/종료 프레임 제어 (FLF2V) | ❌ | ✅ |

| 다중 참조 비디오 입력 | ❌ | ✅ (최대 5개) |

| 9-그리드 이미지 입력 | ❌ | ✅ |

| 명령 기반 비디오 편집 | ❌ | ✅ |

| 다국어 립싱크 | ❌ | ✅ |

| 최대 클립 길이 | ~5초 | 15초 |

| 최대 해상도 | 1080P | 1080P |

추가된 기능은 매우 의미있습니다. 시작/종료 프레임 제어, multi-reference 입력, 명령 기반 편집은 모두 Wan 2.6에 없었던 전문가급 워크플로우 기능입니다.

주요 새로운 기능 상세 설명

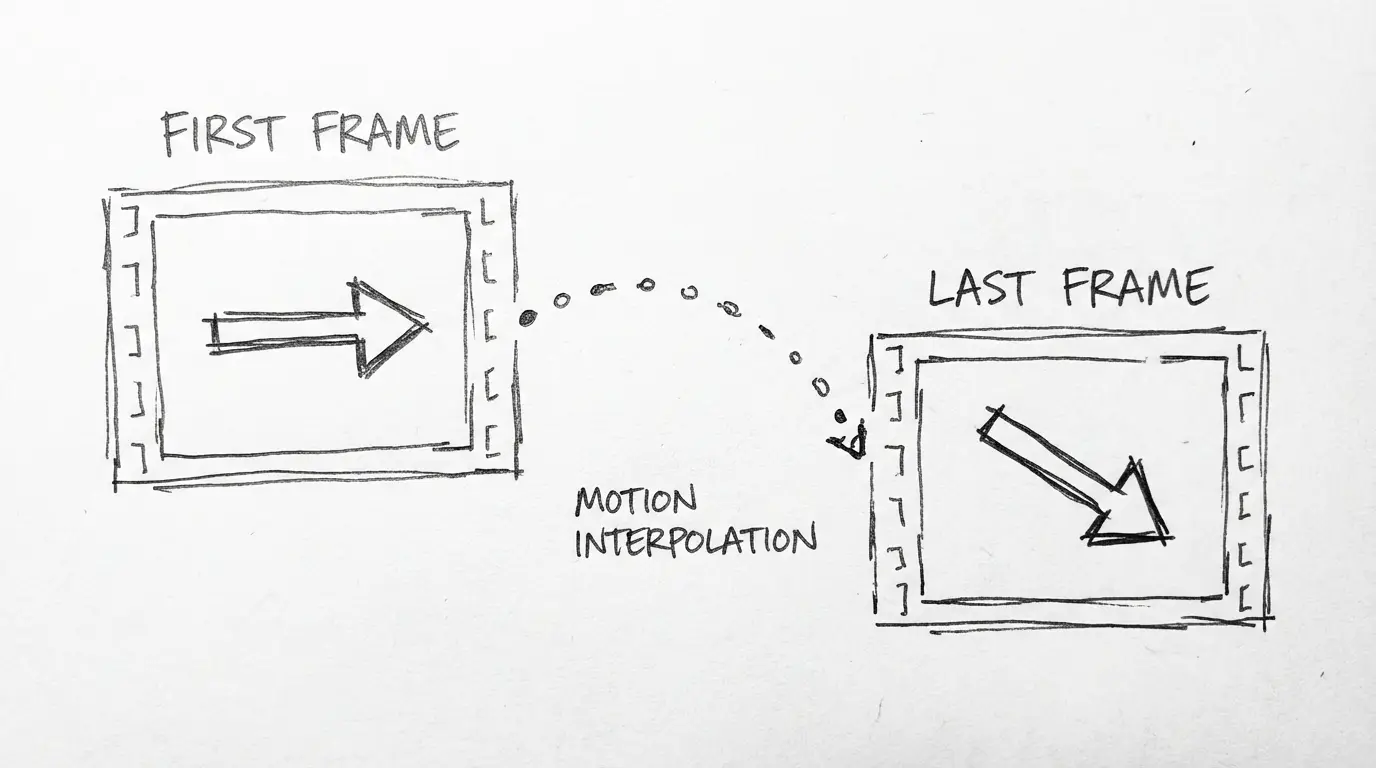

시작 / 종료 프레임 제어 (FLF2V)

FLF2V를 사용하면 비디오의 시작 프레임과 종료 프레임을 모두 직접 정의한 후, Wan 2.7이 두 프레임 사이의 모션을 생성하도록 할 수 있습니다. 이는 상업 작업에서 매우 유용한 제어 기능으로, 특정 시작 구도를 설정하고 샷이 끝나는 지점을 지정한 뒤, 모델이 그 사이의 카메라와 피사체 움직임을 처리하도록 할 수 있습니다.

사용 사례:

- 제품이 중앙에서 시작해 특정 각도에서 끝나야 하는 제품 샷

- 양 끝에서 포즈 변경이 정확해야 하는 캐릭터 애니메이션

- 두 개의 기 설정된 구도 사이의 시네마틱 트랜지션

다중 참조 비디오 입력

Wan 2.7은 최대 5개의 참조 비디오를 동시에 입력받을 수 있습니다. 모델은 이들을 읽어 생성되는 클립의 캐릭터 일관성, 환경 스타일, 모션 패턴에 반영합니다. 이는 단일 이미지 참조보다 더 정교하며, 비디오 생성에서 오래도록 지적된 문제 중 하나인 샷 전반에 걸쳐 캐릭터 외형이 일관되지 않는 문제를 해결합니다.

상업적 사용의 경우, 제품이 움직이는 방식, 인물의 외모, 원하는 환경 스타일의 예시를 제공하면 모델이 해당 컨텍스트를 새로운 생성 결과에 적용한다는 의미입니다.

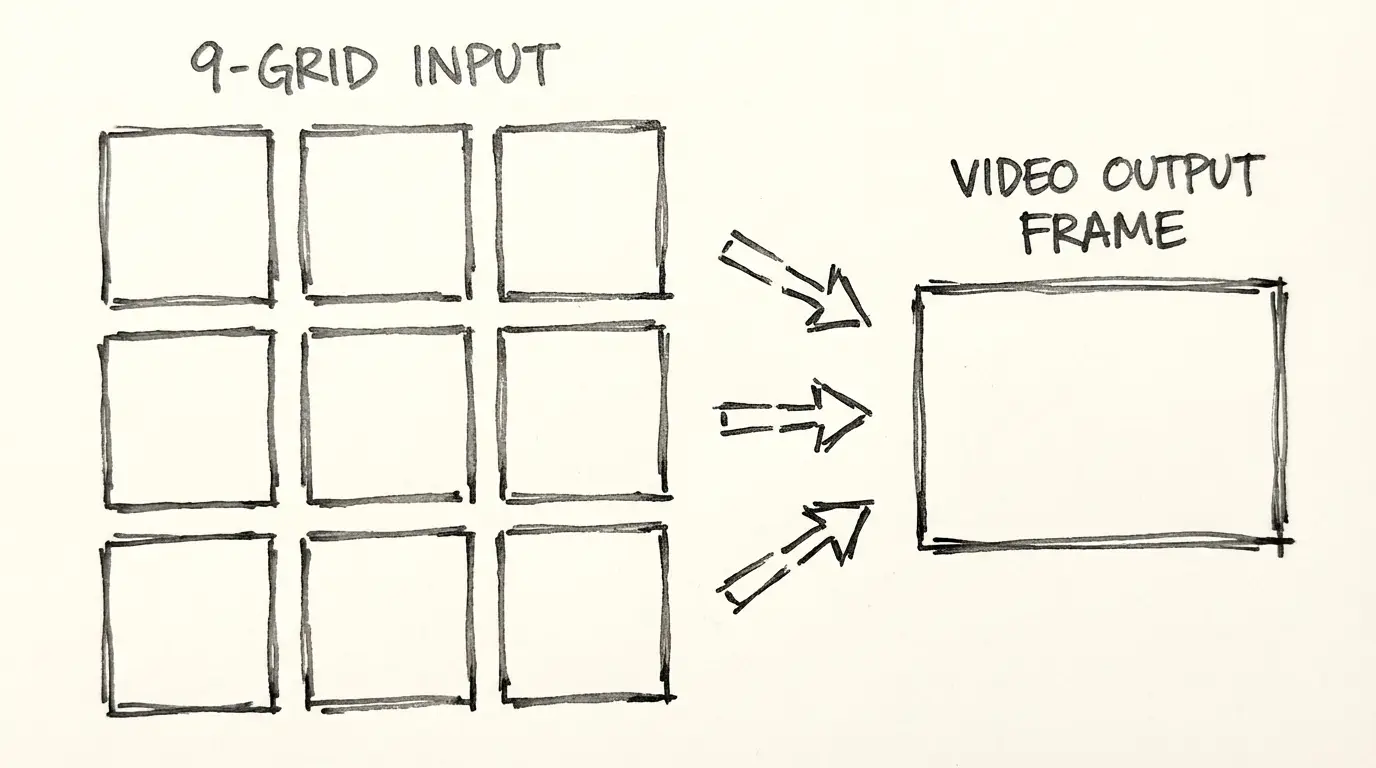

9-그리드 이미지 입력

9-그리드 입력은 3×3 배열의 이미지를 하나의 입력으로 받아들입니다. 모델은 9개 프레임 모두를 읽어 여러 각도에서 컨텍스트, 캐릭터, 환경을 이해합니다. 이는 단일 참조 이미지로는 충분한 디테일을 담을 수 없는 캐릭터 일관성 작업에 특히 유용합니다.

명령 기반 비디오 편집

처음부터 다시 생성하는 대신, Wan 2.7은 기존 비디오를 수정하기 위한 자연어 명령을 입력받을 수 있습니다. 배경 색상, 조명 분위기, 피사체 의상, 시각적 스타일 등 변경하고 싶은 내용을 설명하면, 모델이 원본 모션을 유지하면서 편집을 적용합니다.

이는 승인된 모션에 대한 작은 조정이 빈번한 상업 비디오 제작에서 반복 작업 비용을 크게 줄여줍니다.

다국어 립싱크

Wan 2.7에 다국어 립싱크 지원이 추가되어, 생성된 캐릭터 음성 애니메이션을 여러 언어의 오디오와 동기화할 수 있습니다. 이는 현지화 워크플로우에서 매우 유용한 기능입니다.

기술 사양

| 사양 | Wan 2.7 |

|---|---|

| 아키텍처 | Diffusion Transformer + Flow Matching |

| 매개변수 | ~270억 (추정) |

| 해상도 | 480P, 720P, 1080P |

| 길이 | 2–15초 |

| 화면 비율 | 16:9, 9:16, 1:1 |

| 모드 | T2V, I2V, FLF2V, 명령 편집 |

| API 접근 | WaveSpeedAI, Alibaba Cloud DashScope |

| 오픈소스 | Apache 2.0 계획됨 (출시 시 상태 미정) |

| 처리 시간 | 5초 길이 1080P 클립 기준 약 30초 ~ 2분 |

알려진 제한 사항

어떤 모델도 완벽하지 않습니다. Wan 2.7이 지원하지 않는 기능은 다음과 같습니다:

- No 4K 네이티브 출력 지원 안됨. 최대 해상도는 1080P입니다. 디지털 사이니지, 영화 프리비즈, 대형 스크린 디스플레이에 4K가 필요하다면 다른 모델을 사용하거나 후반 작업에서 업스케일링해야 합니다.

- 출시 시점 오픈소스 릴리스가 확정되지 않았습니다. Wan 2.1은 Apache 2.0으로 완전히 오픈소스였습니다. 이 글 작성 시점에 Wan 2.7의 오픈소스 릴리스 상태는 공식 발표되지 않았으므로, 최신 정보는 Alibaba Wan GitHub에서 확인하세요.

- 공식 가격이 발표되지 않았습니다. WaveSpeedAI와 DashScope의 API 가격은 해당 플랫폼에서 직접 확인하셔야 합니다. 기준점은 Wan 2.6 API 요금이지만, Wan 2.7 가격은 다를 수 있습니다.

- 새 모델이라 커뮤니티 테스트가 제한적입니다. Wan 2.7은 최근 출시되어, 구 모델에 쌓인 광범위한 커뮤니티 테스트 데이터가 아직 축적되는 중입니다.

Wan 2.7 사용 방법

옵션 1: NanoBanana 사용 (API 설정 불필요)

NanoBanana의 Wan 2.7 비디오 생성기로 이동하세요. prompt를 작성하고, 길이와 화면 비율을 선택한 뒤 생성하세요. API 키나 DashScope 계정이 필요하지 않습니다.

옵션 2: WaveSpeedAI API

wavespeed.ai에서 계정을 생성하세요. Wan 2.7은 API 엔드포인트로 제공됩니다. prompt, 모드 (T2V 또는 I2V), 길이 (2–15초), 해상도 (480P, 720P, 1080P), 그리고 화면 비율과 함께 POST 요청을 보내세요.

옵션 3: Alibaba Cloud DashScope

이미 Alibaba Cloud 서비스를 사용하고 계시다면 DashScope API를 통해 Wan 2.7에 접근할 수 있습니다. DashScope 콘솔에서 API 키를 생성하고 요청에 Wan 2.7 모델 ID를 참조하세요.

자주 묻는 질문

지금 Wan 2.7 사용해보기

→ Wan 2.7로 생성하기 — text-to-video과 image-to-video, API 설정이 필요하지 않습니다.

고지 사항

모델 정보와 기능 설명은 2026년 3월 Alibaba Tongyi Lab의 Wan 2.7 공식 출시 자료와 WaveSpeedAI API 문서를 출처로 합니다. 오픈소스 출시 상태와 공식 가격은 게시 시점에 확인이 필요했으므로, 각각 공식 Alibaba Wan GitHub와 wavespeed.ai에서 직접 확인하시기 바랍니다.

더 많은 글

PixVerse V6 vs V5.6: 카메라 컨트롤, 오디오, 멀티샷 엔진

PixVerse V6는 2026년 3월 30일에 출시되었습니다. V5.6과 비교했을 때 20개 이상의 시네마 카메라 컨트롤, 네이티브 오디오, 멀티샷 엔진이 추가되었고 1080p 해상도에서 클립 제한을 15초로 늘렸습니다. 아래 직접 비교 분석을 확인하세요.

AI 이미지 에이전트: 도구 전환 없이 한 장의 이미지든 수백 장이든 생성하세요

NanoBanana의 AI 이미지 에이전트는 단일 컨셉 이미지부터 일괄 스타일 전환까지 모든 작업을 한 번의 대화로 처리합니다. prompt 엔지니어링이 전혀 필요 없습니다

Wan 2.7 vs Wan 2.6: 실제로 무엇이 달라졌을까

Wan 2.7에는 Wan 2.6에 없었던 첫/마지막 프레임 제어, 9-그리드 이미지 입력, multi-reference 비디오, 명령어 편집 기능이 추가되었습니다. 어떤 점이 바뀌었고 각 버전을 언제 사용해야 하는지 실용적으로 정리했습니다