Wan 2.7: El nuevo modelo de vídeo de Alibaba con control por primer fotograma y clips de 15 segundos

Wan 2.7 incorpora control de primer/último fotograma, entrada de vídeo multi-reference y edición basada en instrucciones a la línea de modelos de vídeo de código abierto de Alibaba. Aquí tienes todos los cambios respecto a Wan 2.6.

TL;DR — 5 cosas que debes saber

- ✅ Control de primer/último fotograma (FLF2V) — establece el fotograma de apertura y cierre, Wan 2.7 rellena el movimiento entre ellos

- ✅ Hasta 5 entradas de videos de referencia — introduce múltiples clips de referencia para guiar el personaje, el entorno y el estilo de movimiento

- ✅ Clips de hasta 15 segundos — 3 veces más largo que los modelos Wan anteriores

- ✅ Edición de video por instrucciones — cambia fondos, iluminación o estilo mediante lenguaje natural

- ❌ Sin salida nativa 4K — la resolución máxima es 1080P; el estado de lanzamiento de código abierto no está confirmado en el lanzamiento

¿Qué es Wan 2.7?

Wan 2.7 es el último modelo de generación de video de Tongyi Lab de Alibaba. Estuvo disponible en marzo de 2026 a través de la API de WaveSpeedAI (wavespeed.ai) y de la plataforma DashScope de Alibaba Cloud, con un lanzamiento oficial GitHub pendiente.

Wan es la familia insignia de generación de video de código abierto de Alibaba. Wan 2.1 se lanzó bajo Apache 2.0 y atrajo una adopción sustancial por parte de desarrolladores. Wan 2.7 es la versión más capaz hasta la fecha, agregando un conjunto de controles de grado profesional que faltaban en las versiones anteriores.

El modelo se construye sobre una arquitectura Diffusion Transformer + Flow Matching — estimada en alrededor de 27 mil millones de parámetros. Esto lo coloca en la misma clase arquitectónica que la generación actual de modelos de video de alto rendimiento, que usa coincidencia de flujo latente en lugar de la difusión antigua estilo DDPM para una generación más rápida y estable.

¿Qué cambió respecto a Wan 2.6?

Wan 2.7 no es un parche menor. Aquí tienes la diferencia de características prácticas:

| Característica | Wan 2.6 | Wan 2.7 |

|---|---|---|

| Texto a video | ✅ | ✅ |

| Imagen a video | ✅ | ✅ |

| Control de primer/último fotograma (FLF2V) | ❌ | ✅ |

| Entrada de múltiples videos de referencia | ❌ | ✅ (hasta 5) |

| Entrada de imagen de cuadrícula de 9 | ❌ | ✅ |

| Edición de video por instrucciones | ❌ | ✅ |

| Sincronización de labios multiidioma | ❌ | ✅ |

| Duración máxima de clip | ~5s | 15s |

| Resolución máxima | 1080P | 1080P |

Las adiciones son sustanciales. El control de primer/último fotograma, la entrada multi-reference y la edición por instrucciones son todas capacidades de flujo de trabajo profesional que faltaban en Wan 2.6.

Nuevas funciones clave en detalle

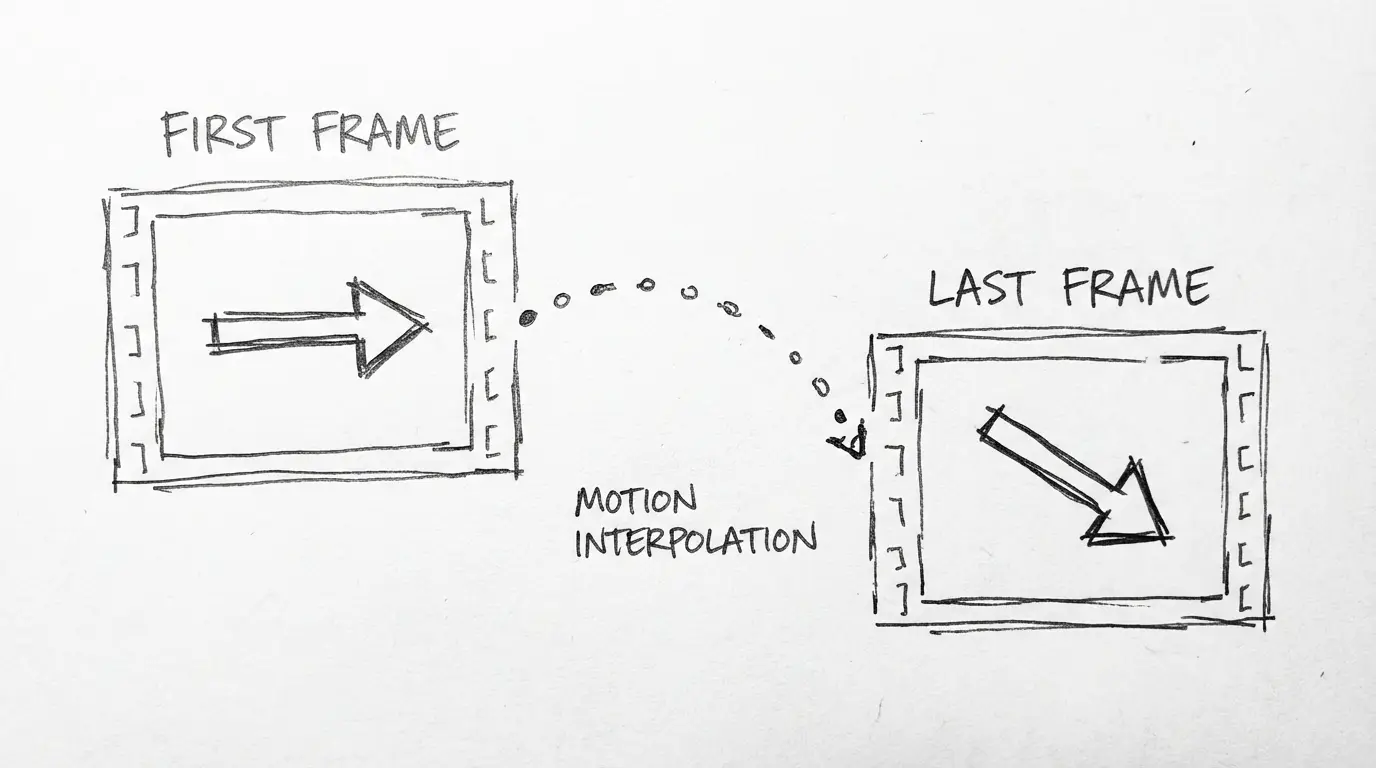

Control de primer / último fotograma (FLF2V)

FLF2V te permite definir tanto el primer como el último fotograma de un video, para que luego Wan 2.7 genere el movimiento entre ellos. Esta es una superficie de control muy útil para trabajo comercial — puedes establecer una composición de inicio específica, especificar dónde termina la toma y dejar que el modelo se encargue del movimiento de la cámara y el sujeto en el medio.

Casos de uso:

- Tomas de producto donde necesitas que el artículo empiece centrado y termine en un ángulo específico

- Animaciones de personajes donde los cambios de pose deben ser exactos en ambos extremos

- Transiciones cinematográficas entre dos composiciones establecidas

Entrada de videos de múltiples referencias

Wan 2.7 acepta hasta 5 videos de referencia simultáneamente. El modelo los lee para definir la consistencia del personaje, el estilo del entorno y los patrones de movimiento en el clip generado. Esto es más sofisticado que la referencia de una sola imagen y aborda una de las quejas más persistentes sobre la generación de video: personajes que no mantienen una apariencia consistente entre tomas.

Para uso comercial, esto significa que puedes proporcionar ejemplos de cómo se mueve un producto, cómo se ve una persona o qué estilo de entorno quieres — y el modelo aplica ese contexto a nuevas generaciones.

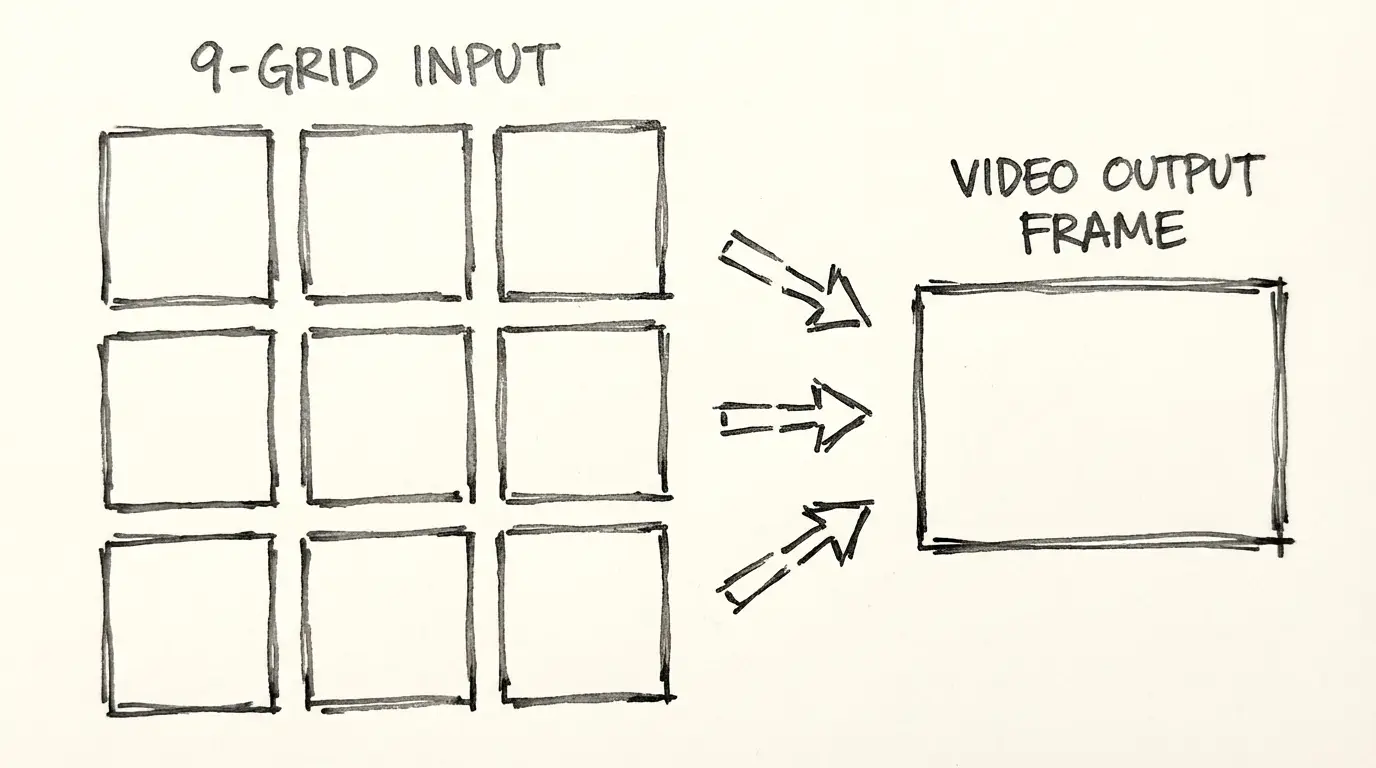

Entrada de imagen de cuadrícula de 9

La entrada de cuadrícula de 9 acepta una disposición de 3×3 de imágenes como una sola entrada. El modelo lee los nueve fotogramas para entender el contexto, el personaje o el entorno desde múltiples ángulos. Esto es particularmente útil para trabajos de consistencia de personajes donde una sola imagen de referencia no captura suficiente detalle.

Edición de video por instrucciones

En lugar de regenerar desde cero, Wan 2.7 acepta instrucciones en lenguaje natural para modificar un video existente. Puedes describir lo que quieres cambiar — color de fondo, ambiente de iluminación, ropa del sujeto o estilo visual — y el modelo aplica la edición mientras conserva el movimiento original.

Esto reduce significativamente el costo de iteración para la producción de video comercial, donde los ajustes pequeños a un movimiento aprobado son comunes.

Sincronización de labios multiidioma

Wan 2.7 agrega soporte de sincronización de labios multiidioma, lo que significa que las animaciones de habla de personajes generadas se pueden sincronizar con audio en diferentes idiomas. Esta es una característica muy útil para flujos de trabajo de localización.

Especificaciones técnicas

| Especificación | Wan 2.7 |

|---|---|

| Arquitectura | Diffusion Transformer + Flow Matching |

| Parámetros | ~27B (estimado) |

| Resoluciones | 480P, 720P, 1080P |

| Duraciones | 2–15 segundos |

| Relaciones de aspecto | 16:9, 9:16, 1:1 |

| Modos | T2V, I2V, FLF2V, edición por instrucciones |

| Acceso por API | WaveSpeedAI, Alibaba Cloud DashScope |

| Código abierto | Apache 2.0 planeado (estado pendiente en el lanzamiento) |

| Tiempo de procesamiento | ~30 segundos a 2 minutos para un clip de 5 segundos a 1080P |

Limitaciones conocidas

Ningún modelo es perfecto. Esto es lo que no hace Wan 2.7:

- Sin salida nativa 4K. La resolución máxima es 1080P. Si necesitas 4K para señalización digital, previsualización cinematográfica o pantallas grandes, necesitarás usar un modelo diferente o escalar en postproducción.

- Lanzamiento de código abierto no confirmado en el lanzamiento. Wan 2.1 fue completamente de código abierto bajo Apache 2.0. El estado de lanzamiento de código abierto de Wan 2.7 no se había anunciado oficialmente al momento de escribir este artículo — consulta el Alibaba Wan GitHub para obtener la información más reciente.

- No se publicó precios oficiales. Los precios de la API en WaveSpeedAI y DashScope deben verificarse en esas plataformas. El punto de referencia son las tarifas de la API de Wan 2.6, pero los precios de Wan 2.7 pueden diferir.

- Modelo nuevo, con pruebas comunitarias limitadas. Wan 2.7 es reciente. Las pruebas comunitarias más amplias que existen para modelos más antiguos aún se están acumulando.

Cómo usar Wan 2.7

Opción 1: Usar NanoBanana (no requiere configuración de API)

Ve al generador de videos Wan 2.7 en NanoBanana. Escribe un prompt, selecciona duración y relación de aspecto, y genera. No se requiere clave API ni cuenta de DashScope.

Opción 2: API de WaveSpeedAI

Crea una cuenta en wavespeed.ai. Wan 2.7 está disponible como endpoint de API. Envía una solicitud POST con tu prompt, modo (T2V o I2V), duración (2–15s), resolución (480P, 720P, 1080P) y relación de aspecto.

Opción 3: Alibaba Cloud DashScope

Si ya usas servicios de Alibaba Cloud, puedes acceder a Wan 2.7 a través de la API de DashScope. Usa la consola de DashScope para generar claves API y referencia el ID del modelo Wan 2.7 en tus solicitudes.

Preguntas frecuentes

Prueba Wan 2.7 Ahora

→ Generar con Wan 2.7 — text-to-video y image-to-video, no requiere configuración de API.

Divulgación

Los datos del modelo y descripciones de funciones provienen de los materiales de lanzamiento oficiales de Alibaba Tongyi Lab para Wan 2.7 (marzo de 2026) y la documentación de la API de WaveSpeedAI. El estado de lanzamiento de código abierto y los precios oficiales estaban pendientes de confirmación al momento de la publicación — verifica ambos en el GitHub oficial de Alibaba Wan y en wavespeed.ai respectivamente.

Autor

Más artículos

PixVerse V6 vs V5.6: Controles de cámara, audio y el motor de tomas múltiples

PixVerse V6 se lanzó el 30 de marzo de 2026. En comparación con V5.6, añade más de 20 controles de cámara cinematográfica, audio nativo, un motor de tomas múltiples y aumenta el límite de clips a 15 segundos en 1080p. Aquí tienes un análisis directo.

PixVerse V6: Controles de cámara de cine, audio nativo y clips de 15 segundos

PixVerse lanzó V6 el 30 de marzo de 2026 — más de 20 controles de cámara de cine, sincronización de audio nativo, motor de tomas múltiples y salida nativa 1080p de hasta 15 segundos. Aquí te contamos qué cambió y si se adapta a tu flujo de trabajo.

Veo 3.1 Lite Imagen a Vídeo: Convierte fotos de productos en clips en menos de un minuto

Cómo usar el modo image-to-video de Veo 3.1 Lite para crear demostraciones de productos, contenido para redes sociales y vídeos de marca a partir de fotos fijas — con ejemplos reales y consejos de flujo de trabajo