Wan 2.7:阿里巴巴推出具首影幀控制、支援15秒片段的全新影片模型

Wan 2.7 為阿里巴巴的開源影片陣容帶來了首/末影幀控制、multi-reference 影片輸入,以及基於指令的編輯功能。以下說明相較 Wan 2.6 的各項變動。

重點摘要 — 5件必知事項

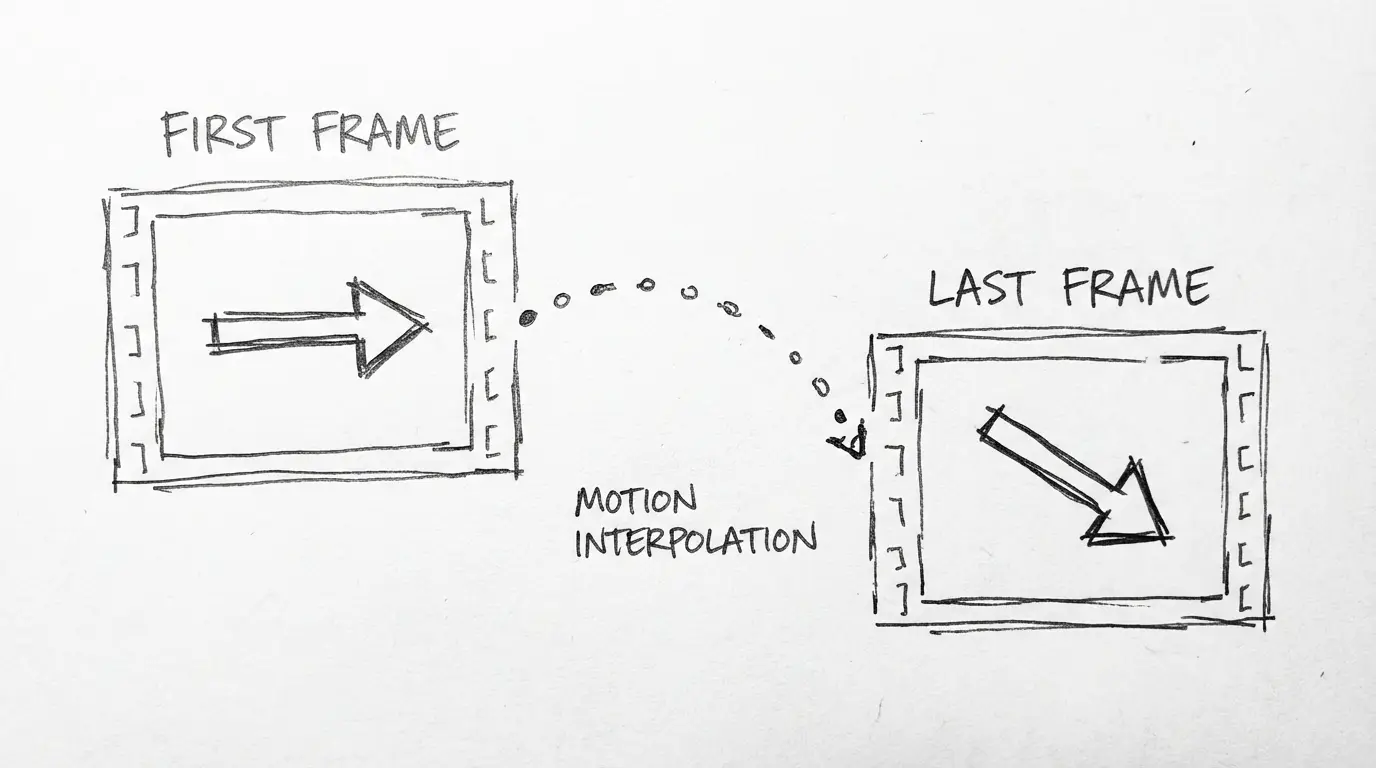

- ✅ 首尾影格控制(FLF2V) — 設定開頭與結尾影格,由Wan 2.7生成兩者之間的動態

- ✅ 最多可輸入5支參考影片 — 匯入多個參考片段,引導生成的角色、環境與動態風格

- ✅ 最長可生成15秒片段 — 是舊版Wan模型的3倍長度

- ✅ 基於指令的影片編輯 — 透過自然語言修改背景、燈光或風格

- ❌ 無原生 4K 輸出 — 最大解析度為1080P;開源發布狀態在上線時尚未確認

什麼是Wan 2.7?

Wan 2.7 是阿里巴巴通義實驗室最新的影片生成模型,於2026年3月透過WaveSpeedAI API(wavespeed.ai)與阿里巴巴雲的DashScope平台開放使用,官方 GitHub 發布仍待確認。

Wan是阿里巴巴旗艦級開源影片生成系列,Wan 2.1以Apache 2.0授權推出,獲得開發者廣泛採用。Wan 2.7是目前功能最強大的版本,加入了一系列舊版缺乏的專業等級控制功能。

該模型建構於 Diffusion Transformer + Flow Matching 架構之上,估計參數量約為270億。這讓它和現今世代的高效能影片模型屬於相同架構等級,使用潛在流匹配而非舊式DDPM風格擴散,實現更快更穩定的生成。

和Wan 2.6相比有哪些更新

Wan 2.7並非小改版,以下是實際功能差異:

| 功能 | Wan 2.6 | Wan 2.7 |

|---|---|---|

| 文字生成影片 | ✅ | ✅ |

| 圖片生成影片 | ✅ | ✅ |

| 首尾影格控制(FLF2V) | ❌ | ✅ |

| 多參考影片輸入 | ❌ | ✅ (最多5支) |

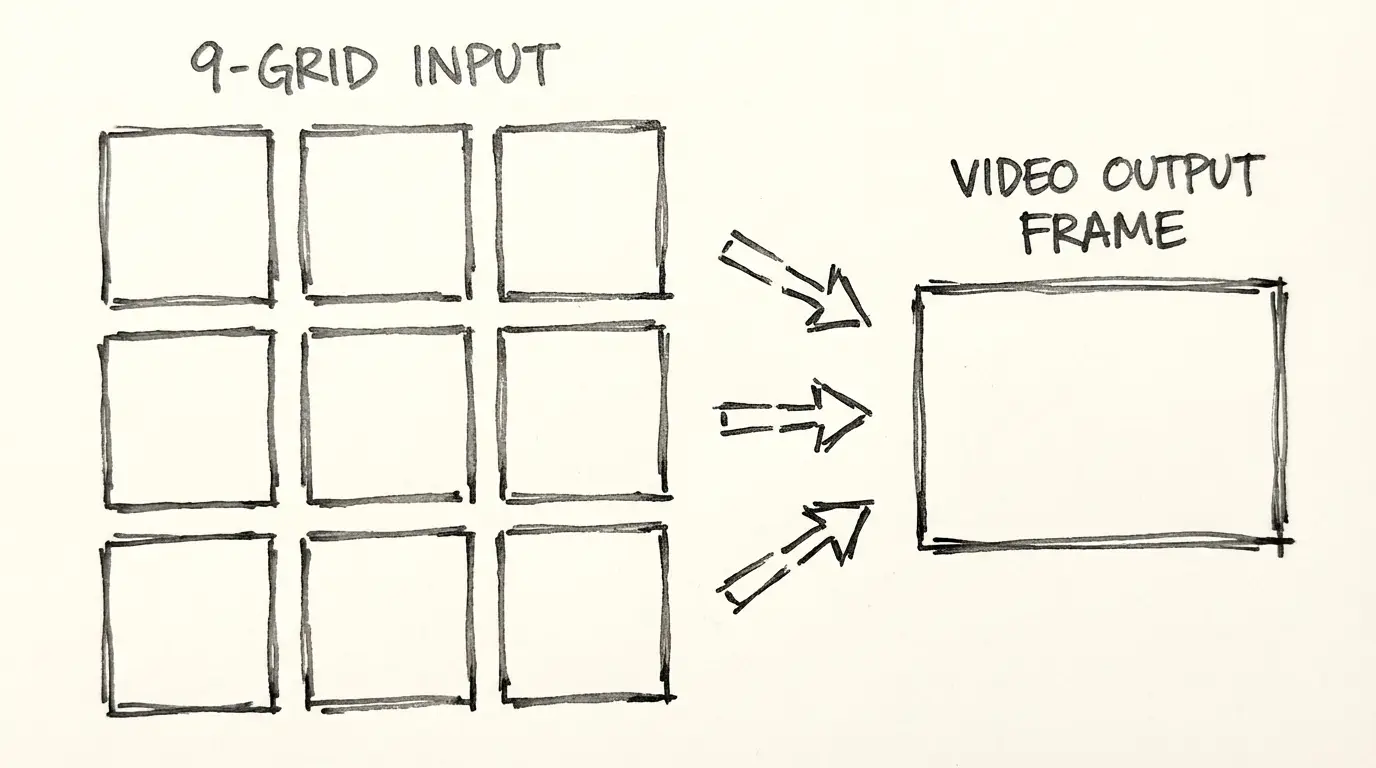

| 九宮格圖片輸入 | ❌ | ✅ |

| 基於指令的影片編輯 | ❌ | ✅ |

| 多語言唇音同步 | ❌ | ✅ |

| 最長片段長度 | 約5秒 | 15秒 |

| 最大解析度 | 1080P | 1080P |

這次新增的功能幅度相當大,首尾影格控制、multi-reference 輸入與指令編輯都是Wan 2.6原本缺乏的專業工作流程功能。

新功能重點詳解

首尾影格控制(FLF2V)

FLF2V讓你可以定義影片的開頭與結尾影格,接著由Wan 2.7生成兩者之間的動態。這對商業製作來說是非常實用的控制功能——你可以設定特定的開場構圖,指定鏡頭的結尾位置,讓模型處理中間的相機與主體移動。

使用場景:

- 產品拍攝:需要產品一開始置中,最後停在特定角度

- 角色動畫:需要開頭與結尾的姿態都完全符合要求

- 兩個既定構圖之間的電影級轉場

多參考影片輸入

Wan 2.7可同時接受最多5支參考影片,模型會讀取這些影片資訊,維持生成片段中角色的一致性、環境風格與動態模式。這比單張圖片參考更成熟,解決了影片生成長期以來的其中一項通病:角色外觀無法在不同鏡頭維持一致。

對商業使用來說,這代表你可以提供產品移動方式、人物外觀或環境風格的範本,模型就會將這些脈絡套用在新的生成內容上。

九宮格圖片輸入

九宮格輸入可接受3×3排列的圖片作為單一輸入,模型會讀取全部九個影格,從多個角度理解上下文、角色或環境。這對需要維持角色一致性的工作特別實用,因為單張參考圖通常無法捕捉足夠細節。

基於指令的影片編輯

Wan 2.7不需要從頭重新生成,它可以接受自然語言指令來修改現有影片。你可以描述想要修改的項目——背景顏色、燈光氛圍、主體服裝或視覺風格——模型會在保留原始動態的前提下套用編輯。

這大幅降低商業影片製作的迭代成本,因為對已經確認的動態進行小調整是相當常見的需求。

多語言唇音同步

Wan 2.7加入多語言唇音同步支援,也就是生成的角色說話動畫可以和不同語言的音訊同步,這對在地化工作流程來說是非常實用的功能。

技術規格

| 規格 | Wan 2.7 |

|---|---|

| 架構 | Diffusion Transformer + Flow Matching |

| 參數量 | ~270億 (推估) |

| 解析度 | 480P, 720P, 1080P |

| 長度 | 2–15 秒 |

| 畫面比例 | 16:9, 9:16, 1:1 |

| 模式 | T2V, I2V, FLF2V, 指令編輯 |

| API 存取 | WaveSpeedAI, 阿里巴巴雲DashScope |

| 開源 | 預計採Apache 2.0 (上線時狀態未定) |

| 處理時間 | 5秒1080P片段約需30秒至2分鐘 |

已知限制

沒有任何模型是完美的,以下是Wan 2.7目前無法做到的事:

- 無原生 4K 輸出。 最大解析度為1080P。如果你需要 4K 用於數位看板、電影預製可視化或大型螢幕展示,你需要使用其他模型或是後製升頻。

- 上線時尚未確認開源發布。 Wan 2.1原本以Apache 2.0完全開源,在本文撰寫之際,Wan 2.7的開源發布狀態尚未正式宣布,請查看阿里巴巴Wan GitHub 取得最新資訊。

- 尚未公布官方定價。 WaveSpeedAI與DashScope的API定價請以該平台公告為準,參考基準是Wan 2.6的API費率,但Wan 2.7的定價可能不同。

- 新模型,社群測試有限。 Wan 2.7是剛推出的新模型,舊模型擁有的廣泛社群測試資料仍在累積中。

如何使用Wan 2.7

選項 1:使用 NanoBanana(無需設定 API)

前往 NanoBanana 上的 Wan 2.7 影片生成器,輸入 prompt、選擇時長和長寬比後即可生成,無需 API 金鑰或 DashScope 帳號。

選項 2:WaveSpeedAI API

至 wavespeed.ai 建立帳號,Wan 2.7 已開放 API 端點,只要傳送 POST 請求,附上你的 prompt、模式(T2V 或 I2V)、時長(2–15 秒)、解析度(480P、720P、1080P)和長寬比即可。

選項 3:Alibaba Cloud DashScope

如果你已經在使用 Alibaba Cloud 服務,就能透過 DashScope API 使用 Wan 2.7,可透過 DashScope 控制台生成 API 金鑰,並在請求中代入 Wan 2.7 的模型 ID。

常見問答

立即體驗 Wan 2.7

→ 使用 Wan 2.7 生成 — 透過 text-to-video 和 image-to-video,無需設定 API。

揭露事項

模型資訊與功能說明源自阿里巴巴通義實驗室於 2026 年 3 月發布的 Wan 2.7 官方發布資料,以及 WaveSpeedAI API 文件。開源發布狀態與官方定價在本文發布時仍待確認,請分別至阿里巴巴 Wan 官方 GitHub 與 wavespeed.ai 查證最新資訊。

更多文章

PixVerse V6:電影級相機控制、原生音訊與15秒影片片段

PixVerse 於2026年3月30日推出V6版本——帶來20多項電影級相機控制、原生音訊同步、多鏡頭引擎,以及最長15秒的1080p原生輸出。以下說明本次更新內容,以及它是否適合你的工作流程

Seedance 2.0:ByteDance多模態AI影片生成完整指南

探索Seedance 2.0,這是ByteDance的革命性AI影片模型,具備多模態輸入、原生音影片同步、2K解析度輸出,以及導演等級的創意控制權。

Google Veo 3.1 Lite:價格僅Veo 3.1 Fast 的一半,速度完全相同

Google 已於 2026 年 3 月 31 日推出Veo 3.1 Lite——這是Veo 家族中最平價的型號,720p 解析度每一秒僅需 0.05 美元。本文將說明它能做什麼、不能做什麼,以及它是否適合你的工作流程。